Nanosystems: Phys. Chem. Math., 2022, 13 (6), 593–607.

Spin Boltzmann machine

Igor S. Lobanov – Faculty of Physics, ITMO University, Saint Petersburg, Russia; igor.lobanov@metalab.ifmo.ru, lobanov.igor@gmail.com

PACS 75.78.-n, 05.65.+b

DOI 10.17586/2220-8054-2022-13-6-593-607

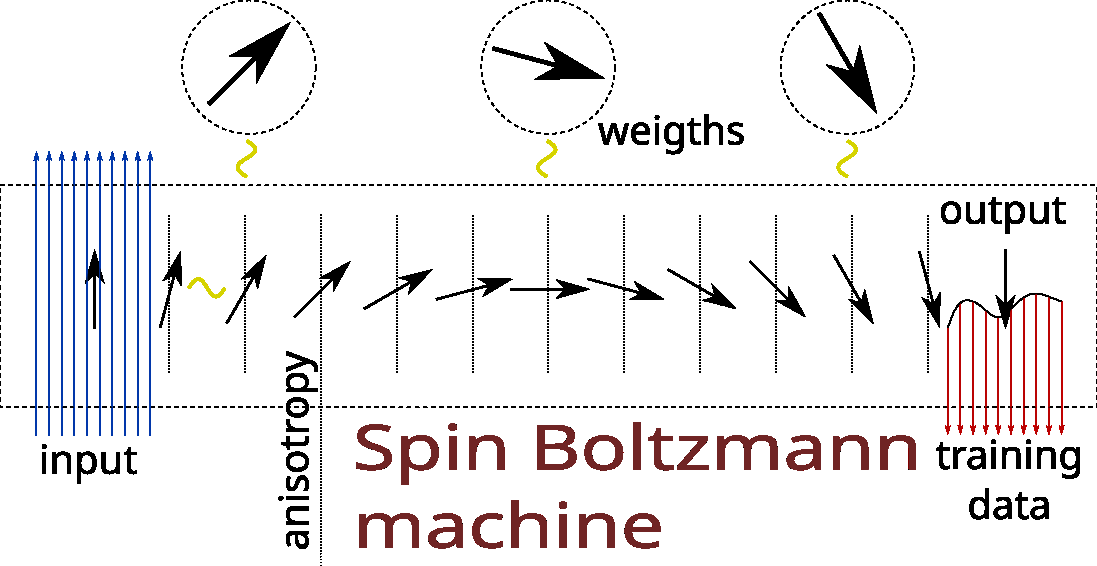

ABSTRACT Boltzmann machine (BM) is a recurrent network, which has a wide range of applications in machine learning (ML) including dimensionality reduction, feature learning and classification. Standard BM is described by the Ising model and can be implemented as a spin ice based device. Such hardware implementation is faster and more energy efficient than a simulation on digital computers. At the moment, a hardware BM is a single purpose device designed on digital computers for a specific task. In the paper we propose a generalized BM capable of fitting parameters by demonstration of training examples, which is done completely inside the spintronic device. Our generalization is based on the Heisenberg model, which is more accurate than the Ising model for spin ice. We show that for some systems minimization of Kullback-Leibler divergence during training of BM is equivalent to minimization of free energy with respect to the biases of the units, hence training of the ML model can be done by energy dissipation. We include the biases as degrees of freedom of the device, whose dynamics is described by the same Landau-Lifschitz-Gilbert equation as for spins representing units of BM. The demonstration of samples from the training set is done by fixing inputs and outputs according to ground truth. The training samples are remembered by the machine becoming minima on the energy landscape implementing a kind of long-term potentiation. The performance of the proposed machine is compared with a single layer perceptron artificial neural network and with a Bernoulli restricted BM on a binary classification problem.

KEYWORDS spectral gap, quantum graph, Schrödinger operator, discrete spectrum.

ACKNOWLEDGEMENTS The work is supported by Russian Science Foundation grant 22-22-00565: https://rscf.ru/en/project/22-22-00565/.

FOR CITATION Lobanov I.S. Spin Boltzmann machine. Nanosystems: Phys. Chem. Math., 2022, 13 (6), 593–607.

[In Russian] Игорь С. Лобанов

Спиновая машина Больцмана

АННОТАЦИЯ Машина Больцмана (МБ) – это рекуррентная сеть, имеющая широкий спектр применений в машинном обучении (МО), включая снижение размерности исходных данных, обучение признакам и задачу классификации. Стандартная МБ описывается моделью Изинга и может быть реализована в виде устройства на основе спинового льда. Такие физические реализации быстрее и энергоэффективнее, чем моделирование на цифровых компьютерах. В настоящее время аппаратные реализации МБ делаются для единственной задачи, а их дизайн рассчитывается на цифровых компьютерах. В настоящей статье мы предлагаем обобщенную МБ, способную самостоятельно, внутри спинтронного устройства, подбирать параметры в процессе демонстрации ей обучающих примеров. Наше обобщение основано на модели Гейзенберга, которая для спинового льда более точна, чем модель Изинга. Мы показываем, что для ряда систем минимизация расстояния

Кульбака-Лейблера в процессе обучения МБ эквивалентно минимизации свободной энергии по пороговым значениям нейронов, т.е. обучение этой модели МО происходит путем диссипации энергии. Мы включаем пороговые значения нейронов в степени свободы системы, полагая, что их динамика описывается тем же уравнением Ландау-Лифшица-Гильберта, которое описывает динамику остальных спинов МБ. Демонстрация примеров происходит путем фиксации входов и выходов согласно тренировочной выборке. Обучающие примеры запоминаются машиной, становясь локальными минимумами на энергетическом ландшафте, тем самым реализуется вариант долговременной потенциации. Производительность предложенной машины сравнена с искусственной нейронной сетью вида однослойного перцептрона и с ограниченной машиной Больцманна на задаче бинарной классификации.

КЛЮЧЕВЫЕ СЛОВА машина Больцмана, модель Гейзенберга, диссипативное обучение.